成立短短一年,就获得超7亿人民币天使轮融资,估值达到数十亿人民币。

最近,北京银河通用机器人有限公司(Galbot)逐渐走进了人们的视野。

尽管已圈粉无数,但外界对这家「低调」的企业却知之甚少,其对外披露的信息更是寥寥无几,新智元特上门求证,挖掘出了很多关于Galbot的一手信息。

Galbot,即Galaxy Bot的缩写,其命名背后蕴含着深远的寓意——展望未来的星辰大海,将智能机器人送达遥远的星际,为人类探索无尽可能。

公司背后的投资方包括:

在被称作「资本寒冬」的当下,这家公司为何受到如此多知名风险投资、产业、科研等多家重磅投资机构的一致看好?

最近,网络上爆火的银河通用第一代具身大模型机器人——盖博特(Galbot)的展示视频给了我们答案。

视频中,在多模态大模型与泛化具身技能的加持下,盖博特进行了智能人机交互并自主完成了一系列泛化操作,描绘出家用机器人的美好未来。

盖博特采用了轮式、双臂、折叠升降的设计,极大的扩展了机器人的操作空间。

相比起无法弯腰、屈膝的足腿式机器人,盖博特将两条腿合并为一条并采用了折叠设计,加上360°全向移动的轮式底盘,让身高1.73米的盖博特,不仅能以「蹲姿」稳定操作地面上的物体,甚至还可以整个身体趴下去操作水平面以下的东西。

而且,升降结构配合七自由度手臂使其站立后能摸到高达2.4米的地方,轻松在2米以上的地方干活,它是世界上已知首款拥有比人类更大工作空间的人形机器人。

相比于盖博特优雅灵动、精巧实用的外观设计,更难得的是,它拥有极其聪明的感知决策大脑和精准控制身体进行泛化操作的小脑。

视频的一开始,盖博特先是自如应对了在开放厨房中主人「取物」和「倒水」的要求。

当主人希望它给自己倒杯饮料时,盖博特能通过多模态大模型的能力「看」懂现场情况,并自主向主人询问所需的饮料类型。在主人选择橙汁后,它双手配合将橙汁倒入了放在桌面的杯子中。

在玻璃杯被意外打碎后,面对主人清理碎片的要求,盖博特展现出惊人的泛化感知和操作技能,直接识别并抓取了透明且形状随机的玻璃碎片,并将其扔到了垃圾桶内。

这完全突破了必须对传统机器人预先设定物体材质、形状、光线条件的这一局限,展现出前所未有的泛化能力。

不仅仅是较硬材质的玻璃,更难的是毛衣这种柔软的物体,无论衣服的款式、袖长、领口形状等,盖博特都可以泛化地用衣架把它们晾起来。

毫不夸张地说,这种能力在世界范围内都属于首次展现。

不过,这丝滑的操作、让人惊掉下巴的泛化能力,会不会又是一个为了博人眼球的摆拍呢?

小编可以负责任地告诉大家 ,这绝不是摆拍,盖博特的真实能力就是有这么强!不信?让我们走进现场验一验!

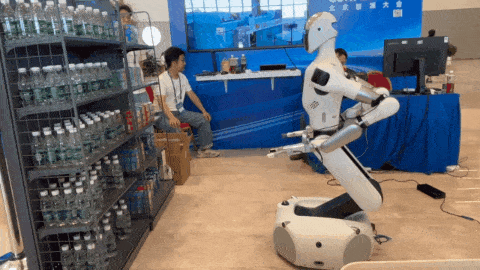

前几天,在有着AI春晚美誉的2024北京智源大会现场,盖博特刚一亮相,现场就瞬间被围得水泄不通。

十平米的展位内摆放着货架和茶几,它一边取货一边互动炫技,获得了在场观众的阵阵惊呼。

(动图已加速)

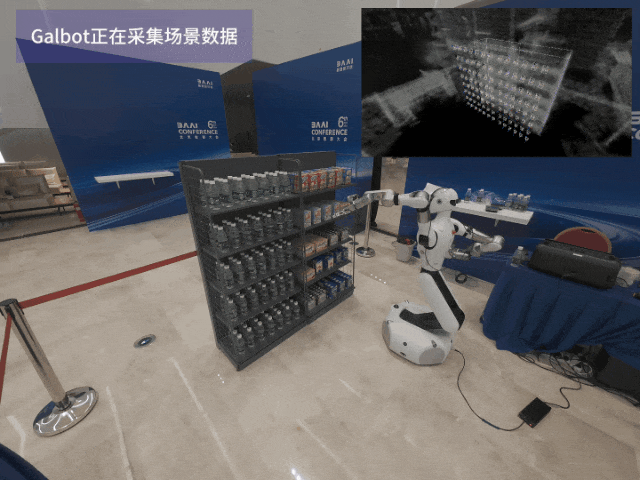

展会现场我们看到地面并没有任何路径标识,货架上也没有二维码或定位标签,那么盖博特是如何实现在这样临时搭建的陌生环境里精准导航和定位识别的呢?

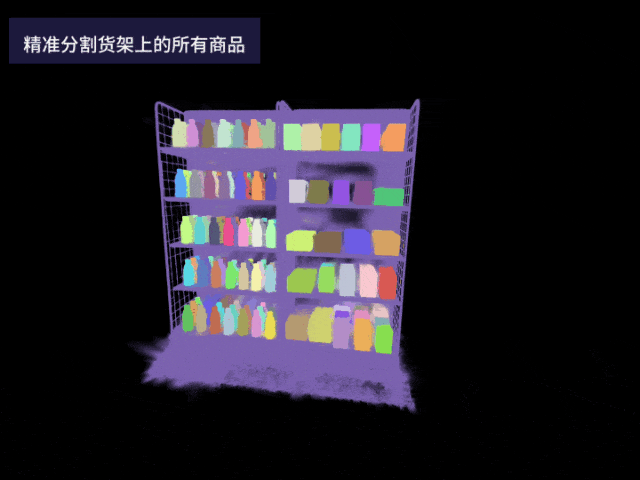

小编通过对工作人员的采访了解到,这得益于银河通用的「开箱即用」产品理念及背后的机器人自动部署技术——它基于3DGS的机器人自动三维场景语义重建,机器人扫描建图后,完成对整个场景内包括透明物体在内的所有物品的几何重建、语义分割和识别,让机器人像员工一样知道商品的大致位置、导航到附近后再进行泛化抓取。

那么它真的能准确识别并抓取货架上的商品吗?这不,这位观众就当场试了一把,下单了一盒饼干。

接到任务后,盖博特开始移动并调整自己的身体高度,经过一番对货架的认真观察,它发现了目标并伸出胳膊,准确地抓起观众下单的饼干。

随后,它转身移动到柜台前,优雅的把饼干放到了小哥面前的取货筐内。

在为期两天的展会现场,盖博特连续工作了18个小时,服务了800多位顾客,完成了1000多项任务,成功率超过97%。这样精彩的表现,也为它赢得了一阵又一阵的掌声。

在展台的另一边,盖博特更进一步展示了具身智能大模型的泛化能力:面对一堆随机摆放的物体,它能听懂人类指令,进行抓取和放置。

一位参展观众向盖博特下达命令:「盖博特,帮我抓一个毛绒玩具。」盖博特立即接受指令,在多个物品中将毛绒玩具精准的识别并抓了起来。

之后盖博特又接到了很多观众现场随手放置的个人物品,如口红、车钥匙、房卡等机器人从来没有见过的物品。

无论被抓取物体的材质、形状、放置位置等如何变化,它都顺利完成了任务,惹的现场观众时时发出惊叹声。

除了智源大会,盖博特还在央视CCTV-2《对话》节目,2024中国人形机器人开发者大会等多个公开场合完成了真机展示。

央视CCTV2《对话》节目:智能理解并执行语音任务

2024中国人形机器人开发者大会:观众提供随机物体抓取

纵观整个人形机器人赛道,敢如此大胆进行现场真机泛化操作演示并与观众开放互动的企业非常少见。银河通用此举,充分展现了作为具身智能机器人领域头部企业的底气。

大语言模型(LLM)爆火之后,许多人都在说:「我们想要机器人帮我们扫地、洗碗、做家务,并不是帮我们作诗、画画、写小说!」,而盖博特展示出的这种泛化干活能力,很可能要让我们的梦想成真了。

以上我们所看到的各种令人印象深刻的泛化技能展示,都源自于其背后强大的技术支撑,今天小编就带着大家一起来深度揭秘盖博特背后的神秘技术。

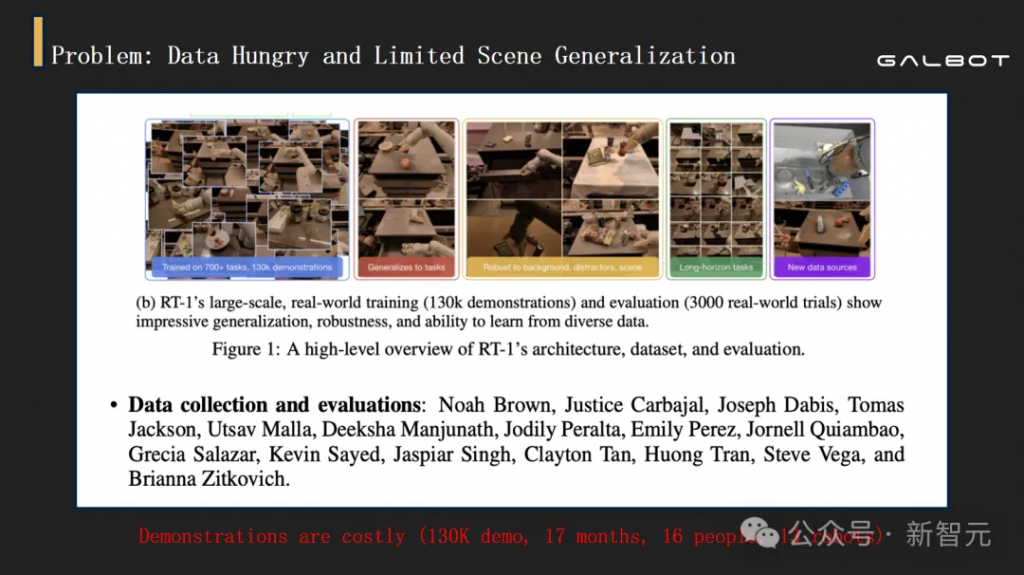

想要训练出机器人泛化的操作技能,必须让它在各种场景、物体与动作上进行训练,这样的数据需求是巨大的。

参考特斯拉开发出的FSD自动驾驶系统,背后是在各种道路、一百万辆车、上亿小时的用户驾驶动作数据。然而对于机器人操作数据,目前并没有足够的机器人也没有人自愿「驾驶」机器人来采集数据。

这条艰难的真实数据采集路线,谷歌的RT系列与特斯拉已经帮我们探索过了:

我们看到,由于真实数据的采集成本过高且容易受到场景、物体的限制,数据规模严重受限,自然不容易实现具身技能较高程度的泛化。

事实上,缺少数据已成为了具身智能实现「从零到一」突破的最大瓶颈。

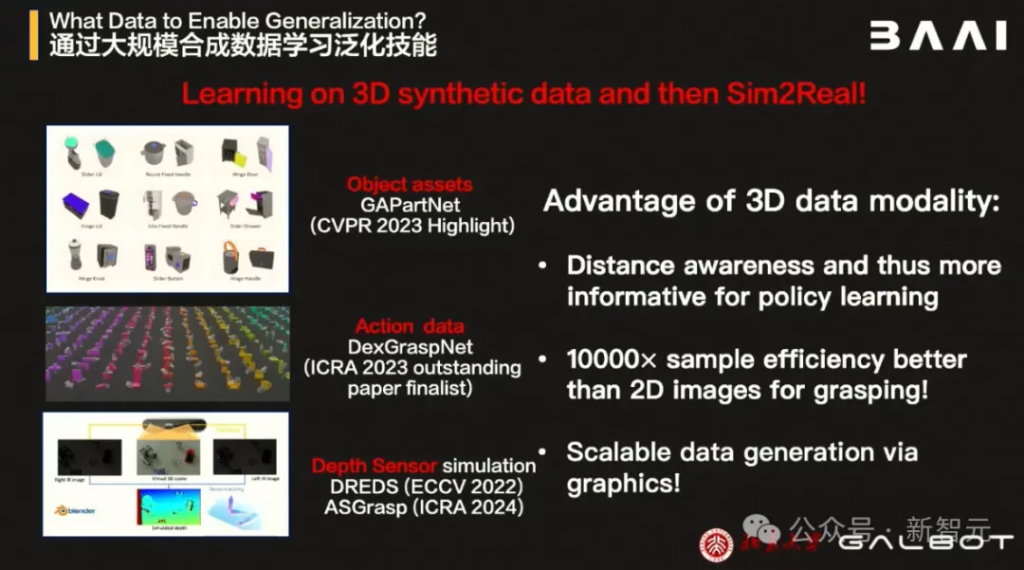

面对这一世界级的难题,银河通用采用了一条独家的技术路径——使用天量的仿真合成数据进行训练,然后进行从虚拟到真实的迁移(Sim2Real)。

为此,团队开发了大量的相关合成数据集,包括百万级的场景数据以及十亿级的操作数据。

相比真实数据,合成数据的优点就在于,可以摆脱现实条件的限制,描绘任意场景和物体,赋予机器人更强的泛化能力,而且能利用计算机图形学技术(CG)进行大规模的数量级扩展。

仿真合成数据的「量」可以保证,那「质」又如何?相比使用真实数据训练的机器人,是否会造成性能损失?这个问题是必须回答的,否则Sim2Real就只是一个伪命题,会让数据降级为「Sim2Sim」。

面对这个问题,银河通用给了我们十足的信心:完全基于合成数据和Sim2Real、没有使用任何真实世界的数据,银河通用、北大和智源的联合研究团队就习得了多种多样的高成功率泛化技能。

面对Google和Tesla花了大量真实数据却没能充分泛化抓取和放置的这一现实,银河通用团队通过多年积累率先实现了对任意材质、几何形态和堆叠的物体进行成功率超过95%的抓取技术。

面对泛化抓取透明物体等世界级难题,银河通用通过三代技术迭代采用合成数据成功得到了传感器无法准确测量的几何深度并基于此获得的点云预测抓取。

在二指抓取之上,银河通用布局人形机器人终局末端:灵巧手,提出了世界最大的灵巧手数据集DexGraspNet。

利用深度加速的可微分力闭合估计器,银河通用实现了高效、稳健地大规模合成稳定且多样化的灵巧抓取实例。数据集涵盖了超过133类的5355个物体,并为每个物体生成了200多种不同的抓取实例,总数达到132万。

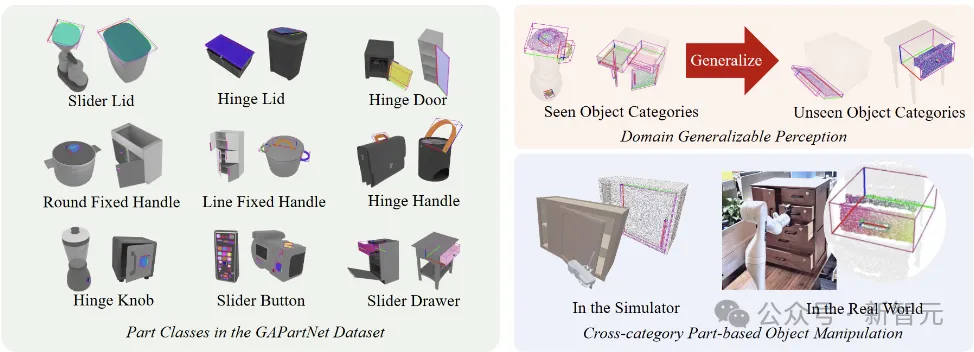

在抓取之上,面对多种多样的操作,团队提出了GAPartNet。

这是一个以「零件」为中心的交互式数据集,包含盖子、手柄等9类8489个零件,分布在1166个物体实例上,且有丰富的语义、姿势注释,让机器人从零件出发学习物体的操作,这样学习到的启发式方法可以更好地推广到对陌生物体的操作。

值得一提的是,以上几篇数据集的论文都被ECCV、CVPR、ICRA等顶级会议接收,其中GAPartNet被选为CVPR 2023的满分亮点论文,DexGraspNet入围ICRA 2023杰出操作论文的候选名单。

这些世界范围内顶尖学术会议的认可进一步体现了银河通用成果的的前沿性和突破性。

除了众多分立的技能,银河通用同时布局具身智能的终极技术,端到端多模态大模型直接输出动作。

具体而言,银河通用选择了从下半身的导航任务开始摸索端到端动作大模型。

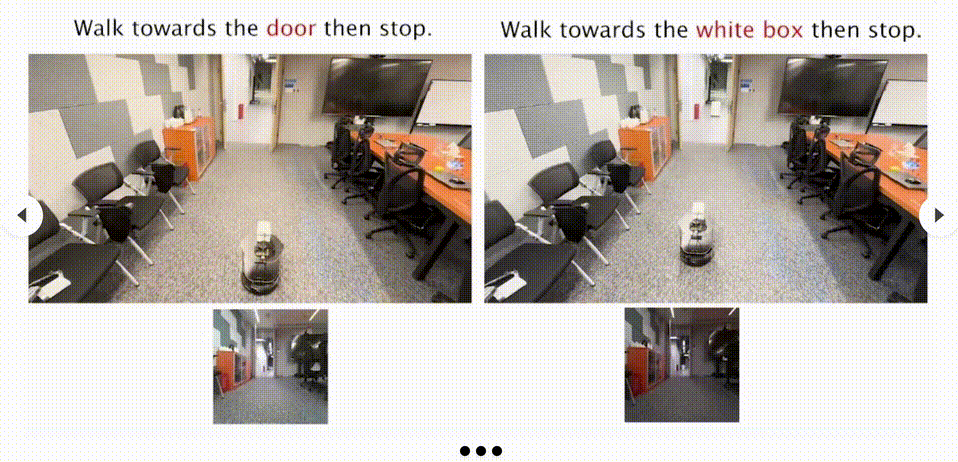

最近被机器人顶级会议RSS 2024接收的NaVid是全球首个基于视频的具身导航多模态大模型,训练数据涵盖了51万纯仿真合成的室内环境视频导航样本(包括动作规划和指令推理两部分)以及76.3万来自真实世界的视频数据(无导航任务和动作信息)。

不同于已有的机器人导航技术,NaVid最出色之处在于充分利用了多模态大模型的优势,并且能以类似人类的方式进行纯视觉导航。

其仅依靠单视角摄像头采集的RGB视频流,而不再需要像传统导航技术那样建图或使用三维点云、里程计、深度图等其它传感器信号,避免了这些信息在真机部署中引入的sim2real gap的影响。

实验表明,NaVid在模拟和真实环境中都实现了SOTA性能,无论是跨数据集,从室内到室外,还是从仿真数据过渡到真实环境,都展现了卓越的泛化能力,成为该领域首个用视频多模态大模型实现泛化导航的里程碑式研究成果。

不久的将来,银河通用将进一步推广具身多模态动作大模型到操作,构成全身导航-操作一体的机器人基础模型。

总结来说,银河通用在数据方面的创新与探索,真正实现了从模拟到真实(Sim2Real)的数据驱动路径,克服了具身智能「从零到一」的数据瓶颈,达成了既有模块化的一个个泛化技能又有端到端的大模型解决方案,引领了世界具身智能的发展。

这家技术世界领先的初创公司,背后团队是什么样的呢?

实际上,尽管已获得了来自顶级机构的7亿元天使轮投资,并在具身智能机器人核心技术取得突破性,但这家公司依然保持着一如既往神秘低调的作风,外界知之甚少。

新智元首次深入探秘了这家备受瞩目的明星公司内部团队,而他们能够在一年的时间内实现机器人真机泛化展示,确实也毫不意外。

说起具身智能不得不提国际具身智能的顶尖学者王鹤博士,他曾于2021年获得了斯坦福大学的博士学位,师从美国「三院」院士Leonidas J. Guibas。再之前,他还获得了清华大学学士学位。

现在,王鹤博士除了在北大担任前沿计算研究中心助理教授,创立并领导了北大具身感知与交互实验室(EPIC Lab)外,还是北京智源研究院具身智能研究中心主任。

提及个人成果,王鹤博士已在国际顶会和期刊上,发表50多篇文章,并荣获ICCV 2023最佳候选论文,ICRA 2023最佳操作论文,Eurographics 2019最佳论文提名奖,以及世界人工智能大会青年优秀论文等。

银河通用的北京研发中心坐落在「中国硅谷」——中关村,周边不仅知名企业星罗棋布,还与北大清华等著名高校隔街相望。

得益于得天独厚的学术研究优势,银河通用与北大、智源研究院牵手,分别成立了具身智能联合实验室、研究中心。

作为北大和智源共同孵化的企业,王鹤博士兼任北大-银河通用具身智能联合实验室的主任,携北大和智源的双重技术积累为盖博特注入了源源不断的创新动力,推动其不断迈向新的高度。

姚腾洲先生,拥有深厚的专业背景。他硕士毕业于北京航空航天大学机器人研究所,师从机器人行业泰斗、中关村智友研究院院长王田苗教授。

姚腾洲先生曾就职于ABB集团上海机器人研发中心,积累了多年工业和服务机器人的研发经验,并拥有销量千万级智能硬件产品的量产经验。在硬件产品的设计、制造和销售方面,具备丰富的行业积淀。

在凝聚了海内外一众顶尖研究人才,且具备丰富商业化实战经验的基础上,银河通用与北京大学、智源研究院展开通力合作,汇聚产、学、研三界力量,不仅成功攻克了具身智能技术的多项难题,还为基础科学研究提供了有力支持,进一步为培养未来机器人行业的精英人才奠定了坚实基础。

基于现有的成果,下一步,银河通用未来将会展开怎样的布局?

今年的GTC大会上,英伟达发布了人形机器人项目GR00T,也就是打造「通用机器人」(Generalist Robot)。

通用,本质上就是希望机器人能够做各种各样的事情。

而且通用有两层含义:一是任务通用,即机器人可以胜任各种任务,且理解人类指令。二是环境通用,也就是机器人不仅可在平地行走,还能在各种挑战的地形中穿梭和工作。

开篇的各种演示,让我们已经看到,未来的员工,也许不再会是个真人。

在类似工厂、车厂这样复杂的环境中,机器人可以独立完成多种任务,在提高生产效率的同时,还为人类提供了更好的协作环境。

机器人亦完全可以胜任24h无人值守的场景,完成打包商品的任务。

王鹤表示,「我们希望,机器人可以在商超、车厂的货物配送,如『线边取料』这样最基础,但是又非常繁复繁杂的任务当中,切实帮助到人类,真正给社会带来新质生产力,赋予企业新的动能」。

除零售场景深度布局外,银河通用还在工业、物流、高校等多个领域展开了深入的场景交流和落地验证,并与多个企业和机构达成了战略合作。未来,还将进一步探索社区养老、家庭服务等更多应用场景。

具身智能机器人将深入实际场景,成为人类的城市管家、生活助手,甚至是工作伙伴,这早已成为了行业的共识。

高盛最新研究报告一度调整了对2035年人形机器人的市场预期——规模预计380亿美元。

Elon Musk更是在最近的股东大会上宣布,人形机器人赛道将创造35万亿美元的市场空间。

如今,无论海内外,从软件平台到硬件开发,从创业公司到科技局巨头,都已入场角逐。

我们希望看到以银河通用为代表的中国企业在世界崭露头角。

相信这一天不会太远。